¶ Was KI heute kann

Stand: Januar 2026. Übersicht über die Fähigkeiten aktueller KI-Systeme.

¶ Grosse Sprachmodelle -- das Fundament

Im Zentrum der aktuellen KI-Revolution stehen grosse Sprachmodelle (Large Language Models, LLMs). Das Prinzip: Ein neuronales Netz mit Hunderten Milliarden Parametern wird auf riesigen Textmengen trainiert -- Bücher, Webseiten, wissenschaftliche Arbeiten, Code. Es lernt die Struktur von Sprache selbst, ohne ein spezifisches Ziel [1].

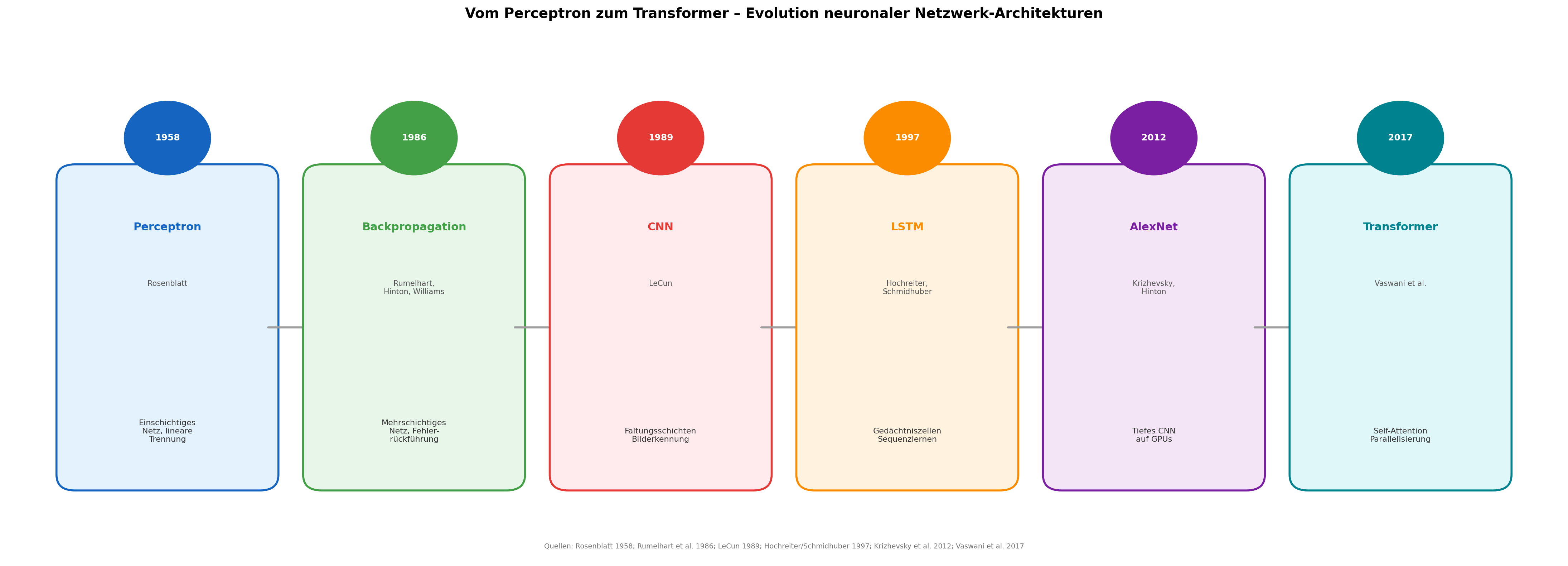

Die entscheidende Architektur heisst Transformer, vorgestellt 2017 in dem Paper "Attention Is All You Need" von Vaswani und sieben weiteren Google-Forschern [2]. Der Transformer betrachtet alle Wörter eines Textes gleichzeitig und berechnet für jedes Wort, wie stark es mit jedem anderen zusammenhängt (Self-Attention). Das macht ihn präziser und massiv parallelisierbar -- perfekt für moderne GPU-Hardware.

¶ Emergente Fähigkeiten -- was niemand programmiert hat

Das Erstaunlichste an grossen Sprachmodellen ist, dass sie Fähigkeiten entwickeln, die niemand explizit programmiert hat. Ab einer bestimmten Modellgrösse tauchen plötzlich neue Kompetenzen auf -- sogenannte emergente Fähigkeiten [3]:

- Logisches Schliessen (Reasoning): Mehrstufige Schlussfolgerungen, die nicht im Training enthalten waren

- Code-Generierung: Funktionierenden Programmcode schreiben in Dutzenden Sprachen

- Mathematische Beweise: Einfache bis mittlere mathematische Probleme lösen

- Zusammenfassung und Analyse: Komplexe Dokumente verdichten und bewerten

- Mehrsprachigkeit: Fliessende Übersetzung zwischen über 100 Sprachen

Diese Fähigkeiten sind nicht das Ergebnis gezielter Programmierung. Sie entstehen als Nebeneffekt der schieren Grösse und Datenmenge -- ein Phänomen, das die KI-Forschung selbst überrascht hat [3].

¶ Multimodale Systeme -- mehr als Text

Seit 2023 verarbeiten führende KI-Modelle nicht nur Text, sondern mehrere Modalitäten gleichzeitig:

| Modalität | Beispiel |

|---|---|

| Text | Essays, Verträge, Code, Gedichte |

| Bilder | Foto eines Kühlschranks analysieren, Rezept vorschlagen |

| Audio | Sprache erkennen, Simultanübersetzung |

| Video | Szenen beschreiben, Inhalte zusammenfassen |

GPT-4 war das erste weit verbreitete multimodale Modell (März 2023). Google Gemini und Anthropic Claude folgten mit eigenen multimodalen Fähigkeiten [4] [5] [6].

¶ Leistung in menschlichen Prüfungen

KI-Systeme bestehen inzwischen Prüfungen, die für Menschen anspruchsvoll sind:

| Prüfung | GPT-4 Ergebnis | Menschlicher Durchschnitt |

|---|---|---|

| US-Anwaltsprüfung (Bar Exam) | Top 10% | 50. Perzentil |

| Medizin-Lizenzierung (USMLE) | über 90% in allen 3 Teilen | Bestehensgrenze bei ~60% |

| Biologie-Olympiade | bestanden | -- |

| SAT Mathematik | 700/800 | 528/800 |

GPT-3.5 hatte bei der Anwaltsprüfung noch unter den schlechtesten 10% gelegen. GPT-4, nur ein halbes Jahr später, lag bei den besten 10%. Die Verbesserungsrate ist beispiellos [4].

¶ Code-Generierung -- das Ende eines Berufsbilds

Anfang 2026 identifiziert Anthropics Claude Fehler in komplexem Programmcode schneller als erfahrene Entwickler -- und liefert die Lösung mit [5]. Nicht gelegentlich, sondern systematisch:

- Verschachtelte Logikfehler in verteilten Systemen

- Race Conditions in parallelen Architekturen

- Subtile Sicherheitslücken, die menschliche Reviewer übersehen

Die Rolle des Programmierers verschiebt sich: Nicht mehr derjenige, der Code schreibt, sondern derjenige, der das Problem versteht und das Ergebnis prüft.

¶ Verbreitung -- die schnellste Adoption der Geschichte

ChatGPT erreichte nach seiner Veröffentlichung am 30. November 2022 eine beispiellose Verbreitungsgeschwindigkeit [7]:

| Dienst | Zeit bis 1 Mio. Nutzer |

|---|---|

| Netflix | 3,5 Jahre |

| 10 Monate | |

| Spotify | 5 Monate |

| 2,5 Monate | |

| ChatGPT | 5 Tage |

Innerhalb von zwei Monaten nutzten 100 Millionen Menschen ChatGPT. Die Schweizer Grossbank UBS bezeichnete es als die schnellste Verbreitung einer Verbraucheranwendung in der Geschichte des Internets [7].

¶ Was KI nicht kann

Trotz aller Fortschritte haben aktuelle KI-Systeme klare Grenzen:

- Halluzinationen: KI erfindet gelegentlich Fakten mit derselben Überzeugungskraft wie korrekte Antworten

- Kein Weltwissen in Echtzeit: Wissen ist auf den Trainingszeitraum begrenzt

- Kein Bewusstsein: KI simuliert Verständnis, besitzt aber kein Bewusstsein und keine Absichten

- Keine physische Interaktion: Rein digitale Fähigkeiten, keine körperliche Geschicklichkeit

Die Grenze zwischen dem, was KI kann und was nicht, verschiebt sich allerdings schneller als jede Prognose es vorhergesagt hat.

¶ Literaturverzeichnis

[1] OpenAI: GPT-4 Technical Report. arxiv.org, März 2023.

[2] Vaswani, Ashish et al.: Attention Is All You Need. NeurIPS, 2017.

[3] Wei, Jason et al.: Emergent Abilities of Large Language Models. Transactions on Machine Learning Research, 2022.

[4] OpenAI: GPT-4 Technical Report. arxiv.org, März 2023.

[5] Anthropic: Claude 3 Technical Report. anthropic.com, März 2024.

[6] Google DeepMind: Gemini -- A Family of Highly Capable Multimodal Models. Dezember 2023.

[7] UBS Evidence Lab: ChatGPT -- The Fastest Growing Consumer Application in History. Februar 2023.