¶ Autonome KI-gesteuerte Schwarmabwehr

ℹ️ This page was automatically translated from German and may still need review.

View German version

As of March 2026.

¶ Introduction

Die Bekämpfung von Drohnenschwärmen — koordinierte Angriffe mit Dutzenden bis Hunderten von unbemannten Luftfahrzeugen gleichzeitig — stellt eine der grössten Herausforderungen der modernen Luftverteidigung dar. Menschliche Operateure können die Geschwindigkeit und Komplexität solcher Angriffe nicht bewältigen; die Reaktionszeiten liegen im Sekunden- bis Millisekundenbereich, die Number simultaner Ziele überfordert jede manuelle Zielzuweisung. Künstliche Intelligenz (KI) ist daher keine optionale Ergänzung, sondern eine funktionale Notwendigkeit für die Schwarmabwehr.

¶ Das Schwarm-Problem

¶ Bedrohungscharakteristik

Ein Drohnenschwarm unterscheidet sich fundamental von einzelnen Drohnen oder konventionellen Luftangriffen:

- Masse: 10 bis 1'000+ Einheiten, die gleichzeitig im Zielraum eintreffen

- Koordination: Die Drohnen operieren nicht unabhängig, sondern als vernetztes System mit geteilter Zielerkennung und adaptiver Routenplanung

- Resilienz: Der Schwarm ist widerstandsfähig gegen den Verlust einzelner Elemente — er reorganisiert sich autonom

- Heterogenität: Moderne Schwärme können verschiedene Drohnentypen kombinieren (Aufklärer, Jammer, Angriffsdrohnen)

- Cost: Die einzelnen Drohnen sind billig (100–5'000 USD), der Schwarm insgesamt aber durch die schiere Masse wirksam

¶ Das Entscheidungsproblem

Gegen einen Schwarm muss die Luftverteidigung innerhalb von Sekunden:

- Alle Ziele detektieren und klassifizieren

- Bedrohungspriorisierung vornehmen (welche Drohne stellt die grösste Gefahr dar?)

- Effektorzuweisung optimieren (welcher Effektor bekämpft welches Ziel am effizientesten?)

- Munitionsmanagement betreiben (reicht die Munition für den gesamten Schwarm?)

- Kollateralschadenanalyse durchführen

- Feuererlaubnis erteilen oder automatisch auslösen

Bei 100 Zielen und 5 verfügbaren Effektoren entstehen Millionen möglicher Zuweisungskombinationen. Kein menschlicher Operateur kann diese in Echtzeit optimieren.

¶ KI-Entscheidungssysteme

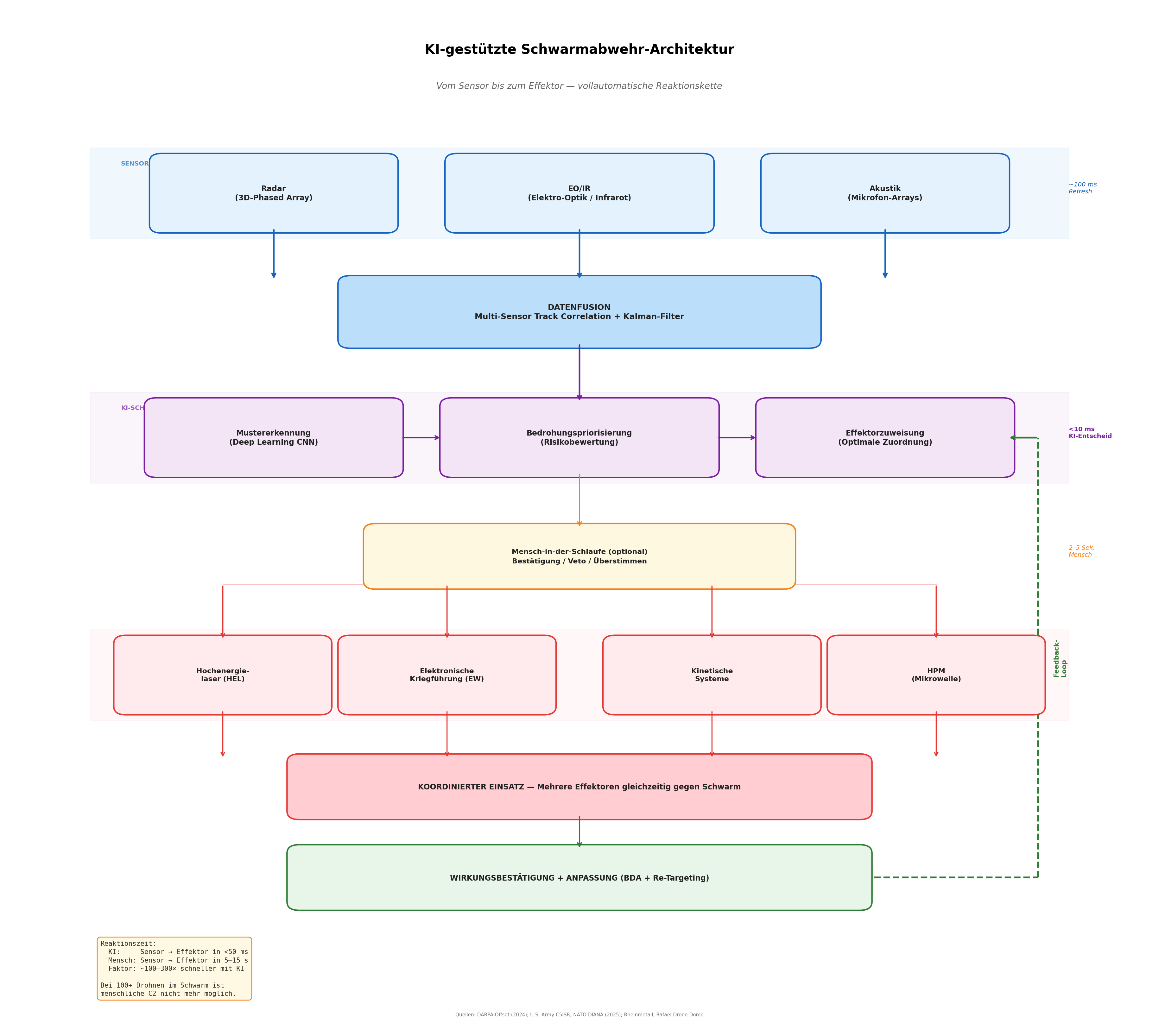

¶ Architektur moderner C-UAS-KI

Die KI-Systems für die Schwarmabwehr basieren typischerweise auf einer mehrschichtigen Architektur:

Sensorebene (Perception):

- Multisensor-Fusion: Radar, Elektrooptik, Akustik, RF-Detektion werden in einem einheitlichen Lagebild zusammengeführt

- Deep-Learning-basierte Objekterkennung und -klassifikation

- Schwarm-Erkennung: Identifikation koordinierter Bewegungsmuster, die auf einen Schwarm hindeuten

Entscheidungsebene (Decision):

- Bedrohungsbewertung: Algorithmen bewerten jedes Ziel anhand von Geschwindigkeit, Kurs, Grösse, Signatur und Kontext

- Effektorzuweisung: Optimierungsalgorithmen (z.B. auf Basis von Reinforcement Learning) ordnen Effektoren Zielen zu

- Cost-Nutzen-Kalkulation: Berücksichtigung von Munitionsvorrat, Cost pro Engagement, Erfolgswahrscheinlichkeit

Effectsebene (Engagement):

- Automatische Feuerleitung für DEW (Laser, HPM)

- Unterstützte Feuerleitung für kinetische Systems

- Schadenserfassung (Battle Damage Assessment) und automatische Neupriorisierung

¶ Konkrete Programme

Mehrere Staaten und Unternehmen entwickeln KI-gestützte C-UAS-Systems:

| Programm | Country | Description |

|---|---|---|

| Coyote Block 3+ / LIDS | USA | KI-gestützte Zielzuweisung für Schwarmbekämpfung |

| SKYSHIELD | Deutschland (Rheinmetall) | Automatisierte Feuerleitung für Oerlikon Revolver Gun |

| Rafael Drone Dome | Israel | Multieffektor-System mit automatischer Klassifikation |

| CHIMERA | USA (DARPA) | KI für heterogene Sensor-Effektor-Vernetzung |

| GUARDIAN | EU (EDF) | Europäisches C-UAS mit KI-Entscheidungsunterstützung |

¶ Autonomie-Level

¶ Klassifikation

Die Debatte um die Autonomie von Waffensystemen wird durch ein Stufenmodell strukturiert, das die Rolle des Menschen definiert:

Level 0 — Manuell (Human-in-the-Loop):

- Der Mensch trifft jede Entscheidung, das System führt aus

- Example: Konventionelle Flugabwehrkanone mit manueller Zielerfassung

- Gegen Schwärme: Unzureichend (zu langsam)

Level 1 — Assistiert (Human-in-the-Loop):

- KI schlägt Ziele und Effektoren vor, Mensch bestätigt jedes Engagement

- Example: Patriot im halbautomatischen Modus

- Gegen Schwärme: Begrenzt wirksam (Engpass: menschliche Bestätigungsgeschwindigkeit)

Level 2 — Teilautonom (Human-on-the-Loop):

- KI führt Engagements autonom durch, Mensch überwacht und kann eingreifen (Veto-Recht)

- Example: Iron Dome im automatischen Modus; SKYSHIELD

- Gegen Schwärme: Wirksam, solange der Mensch den Überblick behält

Level 3 — Autonom (Human-out-of-the-Loop):

- System operiert vollständig autonom, Mensch setzt nur Regeln und Einsatzparameter

- Example: Kein operatives System dieses Levels bekannt (2026)

- Gegen Schwärme: Theoretisch optimal, ethisch und rechtlich umstritten

¶ Praxis: Human-on-the-Loop als Konsens

In der westlichen Doktrin hat sich per 2026 ein Konsens herausgebildet, dass Level 2 (Human-on-the-Loop) der operative Standard für C-UAS-Systems sein soll. Dies bedeutet:

- Die KI trifft Echtzeit-Entscheidungen über Zielerfassung, Priorisierung und Effektorzuweisung

- Ein menschlicher Operateur überwacht den Prozess und kann jederzeit eingreifen

- In definierten Szenarien (z.B. Abwehr gegen offensichtlich feindliche Drohnen über eigenem Militärgelände) kann das System ohne menschliche Einzelfreigabe feuern

- In ambivalenten Szenarien (z.B. urbanes Umfeld, unklare Identifikation) wird auf menschliche Bestätigung zurückgeschaltet

¶ Ethische und rechtliche Fragen

¶ Humanitäres Völkerrecht

Das humanitäre Völkerrecht (insbesondere die Genfer Konventionen und deren Zusatzprotokolle) stellt Anforderungen an den Einsatz von Waffensystemen, die auch für KI-gestützte C-UAS gelten:

- Unterscheidung: Das System muss zwischen militärischen und zivilen Zielen unterscheiden können. Bei Drohnen ist dies komplex — kommerzielle und militärische Drohnen können baugleich sein.

- Verhältnismässigkeit: Der erwartete militärische Advantage muss in einem angemessenen Verhältnis zu möglichen zivilen Schäden stehen.

- Vorsicht: Es müssen alle praktisch möglichen Vorsichtsmassnahmen getroffen werden, um zivile Opfer zu minimieren.

¶ Die LAWS-Debatte

Die Diskussion um Lethal Autonomous Weapons Systems (LAWS) im Rahmen der UN Convention on Certain Conventional Weapons (CCW) ist direkt relevant für KI-gestützte Schwarmabwehr. Die Positionen reichen von einem vollständigen Verbot (unterstützt von über 30 Staaten und der IKRK) bis zur Forderung nach Regulierung (USA, UK, Frankreich, Russland).

Die Switzerland vertritt eine differenzierte Position: Sie unterstützt die Aufrechterhaltung menschlicher Kontrolle über den Einsatz von Gewalt, lehnt aber ein pauschales Verbot ab und plädiert für normative Rahmenwerke, die technologieoffen sind.

¶ Praktische ethische Herausforderungen

- Fehlklassifikation: Was passiert, wenn die KI eine kommerzielle Drohne als Bedrohung identifiziert und zerstört? Wer trägt die Verantwortung?

- Algorithmische Bias: Trainingsdaten können Verzerrungen enthalten, die zu systematischen Fehlern führen

- Cybersicherheit: KI-Systems können durch adversarielle Angriffe (z.B. Adversarial Examples) getäuscht werden

- Verantwortungslücke: Wenn die KI autonom tötet — wer ist verantwortlich? Der Programmierer, der Kommandant, der Staat?

¶ Sources

[1] DARPA — CHIMERA: Counter-Hybrid Intelligent Machines for Autonomous Response Actions

[2] ICRC — Autonomous Weapon Systems: Technical, Military, Legal and Humanitarian Aspects

[3] CSIS — Autonomy in Weapon Systems: The Role of AI in Counter-UAS

[4] NATO — Autonomous Systems and Artificial Intelligence

[5] RAND — Autonomous Weapons: Challenges and Opportunities for U.S. Strategy

[6] Defense News — AI-powered counter-drone systems race to keep up with the threat

[7] EDA — Artificial Intelligence in Defence

[8] Eidgenössisches Departement für auswärtige Angelegenheiten — Autonome Waffensysteme