¶ État des lieux -- L'IA au 1er janvier 2026

État : janvier 2026. Toutes les indications reposent sur des sources publiquement accessibles.

¶ La situation en trois phrases

En janvier 2026, les systèmes d'IA s'améliorent plus vite que les humains ne peuvent les suivre. Les grands modèles de langage réussissent les examens d'avocat, diagnostiquent des maladies et écrivent du code prêt pour la production. Le seuil de l'auto-optimisation est franchi.

¶ Ce qui s'est passé en douze mois

Entre début 2025 et janvier 2026, le paysage de l'IA a fondamentalement basculé :

- OpenAI fait fonctionner des équipes de recherche internes dans lesquelles des agents IA examinent du code de manière autonome, proposent des architectures et évaluent des benchmarks [1].

- Anthropic démontre que Claude lit de manière autonome des articles scientifiques, formule des hypothèses et conçoit des expériences [2].

- Google DeepMind annonce que Gemini a contribué au développement de sa propre version successeur -- de manière mesurable, pas comme déclaration marketing [3].

Le dénominateur commun : l'IA écrit du code avec lequel elle construit une meilleure IA. Elle se teste elle-même, corrige ses propres erreurs, optimise sa propre architecture.

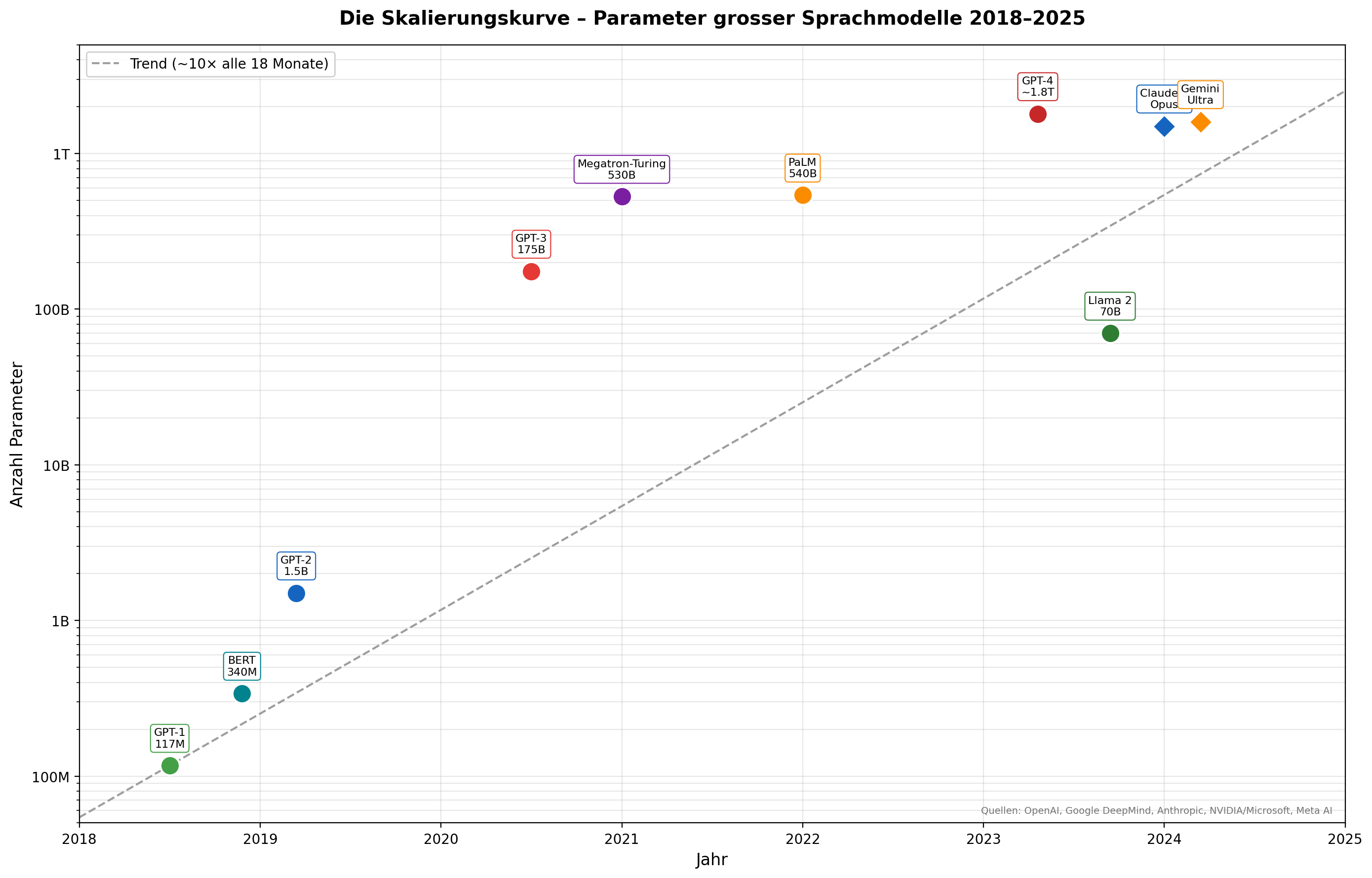

¶ Lois de mise à l'échelle -- Plus grand signifie meilleur

En janvier 2020, Jared Kaplan et ses collègues chez OpenAI ont publié une découverte qui est devenue la doctrine centrale de l'industrie de l'IA : la performance des modèles de langage neuronaux s'améliore de manière prévisible selon une loi de puissance lorsqu'on augmente trois facteurs -- les paramètres, les données d'entraînement et la puissance de calcul [4].

Pas de nouveaux algorithmes nécessaires. Simplement : plus grand.

| Modèle | Année | Paramètres |

|---|---|---|

| GPT-1 | 2018 | 117 millions |

| GPT-2 | 2019 | 1,5 milliard |

| GPT-3 | 2020 | 175 milliards |

| GPT-4 | 2023 | ~1,8 billion (estimé) |

| Claude 3 Opus | 2024 | non divulgué |

| Gemini Ultra | 2024 | non divulgué |

Le nombre de paramètres décuple environ tous les 18 mois [1] [3].

¶ La singularité pratique

Le mathématicien Vernor Vinge a forgé en 1993 le concept de singularité technologique -- ce point hypothétique où les systèmes d'IA s'améliorent plus rapidement que les humains ne peuvent le suivre [5]. Ray Kurzweil a estimé ce moment à 2045 [6]. Il s'est trompé de vingt ans -- dans la mauvaise direction.

Ce qui s'est produit début 2026 n'était pas une singularité de science-fiction. C'était une singularité pratique : l'IA a dépassé l'humain là où cela compte -- au travail.

Un exemple : le Claude d'Anthropic analyse une base de code d'un million de lignes, identifie un bug subtil dans la logique de concurrence et fournit une solution correcte et testée. En quelques minutes. Un expert humain aurait besoin de jours [2].

¶ Ce que cela signifie

Le développement de l'IA n'est plus un progrès linéaire. C'est un processus auto-accélérant. Chaque nouvelle génération de modèle contribue au développement de la suivante. L'humain reste impliqué -- mais son rôle s'est déplacé : du créateur au superviseur.

Pour la Suisse -- avec sa recherche de pointe à l'ETH, l'EPFL et l'IDSIA -- c'est à la fois une chance énorme et un défi existentiel.

¶ Bibliographie

[1] OpenAI : GPT-4 Technical Report. arxiv.org, mars 2023.

[2] Anthropic : Claude 3 Technical Report. anthropic.com, mars 2024.

[3] Google DeepMind : Gemini -- A Family of Highly Capable Multimodal Models. Décembre 2023.

[4] Kaplan, Jared et al. : Scaling Laws for Neural Language Models. OpenAI, janvier 2020.

[5] Vinge, Vernor : The Coming Technological Singularity. VISION-21 Symposium, NASA, 1993.

[6] Kurzweil, Ray : The Singularity Is Near: When Humans Transcend Biology. Viking, 2005.