¶ Ce que l'IA sait faire aujourd'hui

État : janvier 2026. Aperçu des capacités des systèmes d'IA actuels.

¶ Grands modèles de langage -- le fondement

Au centre de la révolution actuelle de l'IA se trouvent les grands modèles de langage (Large Language Models, LLMs). Le principe : un réseau neuronal de centaines de milliards de paramètres est entraîné sur d'immenses volumes de texte -- livres, sites web, travaux scientifiques, code. Il apprend la structure du langage lui-même, sans objectif spécifique [1].

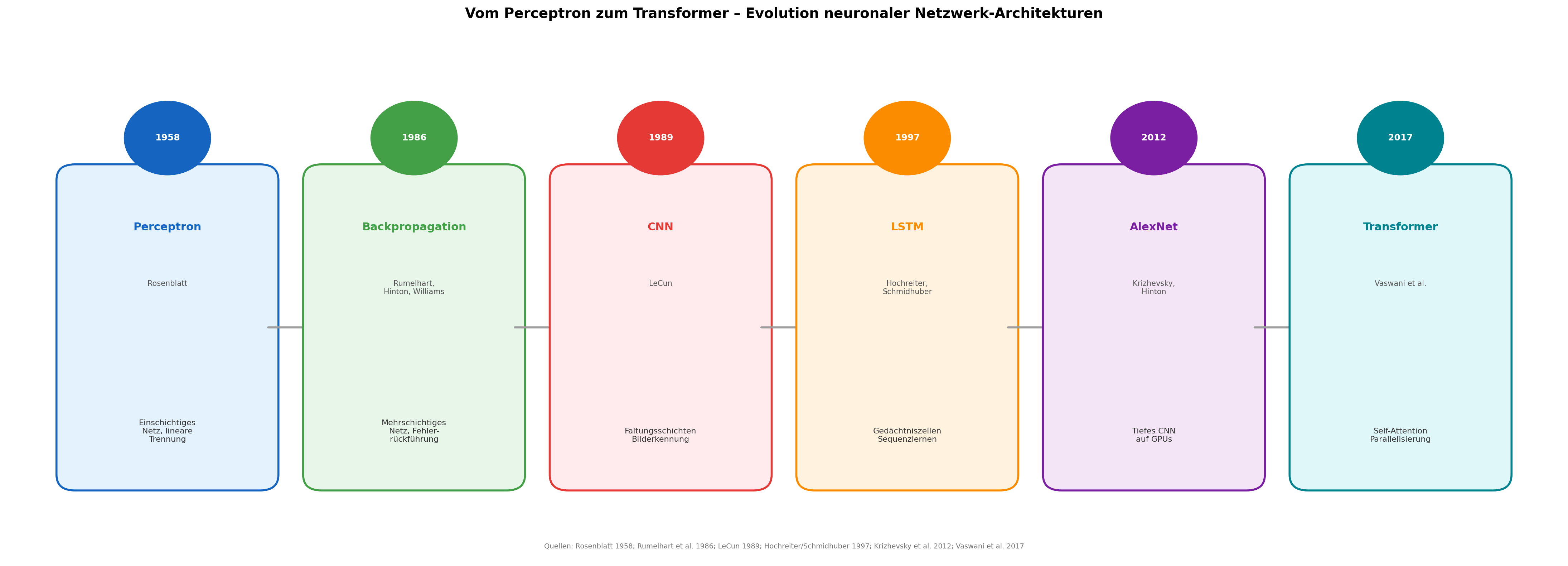

L'architecture décisive s'appelle Transformer, présentée en 2017 dans l'article « Attention Is All You Need » par Vaswani et sept autres chercheurs de Google [2]. Le Transformer considère tous les mots d'un texte simultanément et calcule pour chaque mot à quel point il est lié à chacun des autres (Self-Attention). Cela le rend plus précis et massivement parallélisable -- parfait pour le matériel GPU moderne.

¶ Capacités émergentes -- ce que personne n'a programmé

Le plus étonnant des grands modèles de langage est qu'ils développent des capacités que personne n'a explicitement programmées. À partir d'une certaine taille de modèle, de nouvelles compétences apparaissent soudainement -- les capacités émergentes [3] :

- Raisonnement logique (Reasoning) : Inférences en plusieurs étapes qui n'étaient pas contenues dans l'entraînement

- Génération de code : Écrire du code fonctionnel dans des dizaines de langages

- Démonstrations mathématiques : Résoudre des problèmes mathématiques simples à intermédiaires

- Synthèse et analyse : Condenser et évaluer des documents complexes

- Multilinguisme : Traduction fluide entre plus de 100 langues

Ces capacités ne sont pas le résultat d'une programmation ciblée. Elles émergent comme effet secondaire de la taille et du volume de données -- un phénomène qui a surpris la recherche en IA elle-même [3].

¶ Systèmes multimodaux -- au-delà du texte

Depuis 2023, les modèles d'IA de pointe ne traitent plus seulement du texte, mais plusieurs modalités simultanément :

| Modalité | Exemple |

|---|---|

| Texte | Essais, contrats, code, poèmes |

| Images | Analyser la photo d'un réfrigérateur, suggérer une recette |

| Audio | Reconnaissance vocale, traduction simultanée |

| Vidéo | Décrire des scènes, résumer des contenus |

GPT-4 a été le premier modèle multimodal largement diffusé (mars 2023). Google Gemini et Anthropic Claude ont suivi avec leurs propres capacités multimodales [4] [5] [6].

¶ Performance aux examens humains

Les systèmes d'IA réussissent désormais des examens qui sont exigeants pour les humains :

| Examen | Résultat GPT-4 | Moyenne humaine |

|---|---|---|

| Examen du barreau américain (Bar Exam) | Top 10% | 50e percentile |

| Licence médicale (USMLE) | plus de 90% dans les 3 parties | Seuil de réussite à ~60% |

| Olympiade de biologie | réussi | -- |

| SAT mathématiques | 700/800 | 528/800 |

GPT-3.5 avait encore figuré parmi les 10% les plus faibles à l'examen du barreau. GPT-4, seulement six mois plus tard, figurait parmi les 10% les meilleurs. Le taux d'amélioration est sans précédent [4].

¶ Génération de code -- la fin d'un profil professionnel

Début 2026, le Claude d'Anthropic identifie les erreurs dans du code complexe plus rapidement que des développeurs expérimentés -- et fournit la solution en même temps [5]. Non pas occasionnellement, mais systématiquement :

- Erreurs logiques imbriquées dans des systèmes distribués

- Conditions de concurrence dans des architectures parallèles

- Vulnérabilités subtiles que les relecteurs humains manquent

Le rôle du programmeur se déplace : ce n'est plus celui qui écrit le code, mais celui qui comprend le problème et vérifie le résultat.

¶ Diffusion -- l'adoption la plus rapide de l'histoire

ChatGPT a atteint après sa publication le 30 novembre 2022 une vitesse de diffusion sans précédent [7] :

| Service | Temps jusqu'à 1 mio d'utilisateurs |

|---|---|

| Netflix | 3,5 ans |

| 10 mois | |

| Spotify | 5 mois |

| 2,5 mois | |

| ChatGPT | 5 jours |

En deux mois, 100 millions de personnes utilisaient ChatGPT. La grande banque suisse UBS l'a qualifié de diffusion la plus rapide d'une application grand public dans l'histoire d'Internet [7].

¶ Ce que l'IA ne sait pas faire

Malgré tous les progrès, les systèmes d'IA actuels ont des limites claires :

- Hallucinations : L'IA invente parfois des faits avec la même force de conviction que des réponses correctes

- Pas de connaissance du monde en temps réel : Le savoir est limité à la période d'entraînement

- Pas de conscience : L'IA simule la compréhension, mais ne possède ni conscience ni intentions

- Pas d'interaction physique : Capacités purement numériques, pas de dextérité corporelle

La frontière entre ce que l'IA sait et ne sait pas faire se déplace toutefois plus vite que toute prévision ne l'avait annoncé.

¶ Bibliographie

[1] OpenAI : GPT-4 Technical Report. arxiv.org, mars 2023.

[2] Vaswani, Ashish et al. : Attention Is All You Need. NeurIPS, 2017.

[3] Wei, Jason et al. : Emergent Abilities of Large Language Models. Transactions on Machine Learning Research, 2022.

[4] OpenAI : GPT-4 Technical Report. arxiv.org, mars 2023.

[5] Anthropic : Claude 3 Technical Report. anthropic.com, mars 2024.

[6] Google DeepMind : Gemini -- A Family of Highly Capable Multimodal Models. Décembre 2023.

[7] UBS Evidence Lab : ChatGPT -- The Fastest Growing Consumer Application in History. Février 2023.